(ترجمة خاصة: عرب 48)

منذ انطلاقة موقعي نيتسبيس وياهو! قبل 20 عام، أصبح تطور الإنترنت يدور حول قصص الشركات الجديدة والمنتَجات الجديدة، وهي قصص تشكلت إلى حد كبير من اهتمامات رواد الأعمال وممولي المشاريع. وكانت الحبكة تسير بخط مستقيم وبخطوات مندفعة، ففي عام 1995، جاءت مواقع أمازون وكريغليست، وظهر جوجل ونيتفليكس في عام 1997، ثم ظهرت نابستر وبلوغر في عام 1999، وآي تيونز في 2001، وماي سبيس في 2003، ثم جاء فيسبوك في عام 2004، ويوتيوب في 2005، وتويتر في 2006، ثم آي فون وكيندل في 2007، وأيربنب في 2008، وإنستغرام في 2011، وسناب شات في 2011، وكورسيرا في 2012، وجوجل غلاس في 2013. لقد كان سباقاً كرنفالياً، وكنا نحن العامة الركاب الدائخون.

ولكن تغير شيء في ذاك العام، فقد جاءت أخبار صاعقة عن شبكة الإنترنت لم تتحدث عن شركة جديدة ناشئة أو نظام جديد، بل جاءت على صيغة وثائق غامضة. كانت إحداها عبارة عن ورقة علمية تصف تجربة حاول فيها الباحثون التحكم بمزاج مستخدمي موقع الفيسبوك عن طريق التلاعب بشكل سري بالرسائل التي يرونها. والوثيقة الأخرى كانت حكماً صادراً عن المحكمة العليا للاتحاد الأوروبي بمنح المواطنين حق محو المعلومات القديمة وغير الدقيقة الموجودة في محركات جوجل ومحركات البحث الأخرى. أثارت كلا الوثيقتين حالةً من الذعر والغضب والجدل، فقد أبرزتا مجموعة من القضايا المهمة والمعقدة من دون تقديم أي حلول لها. وقد جاءت هذه الوثائق في سياق انكشاف عمليات التجسس عبر الإنترنت التي نفذتها وكالة الأمن القومي، حيث مثَّل كل ذلك نذيراً – وبطرق متعددة – إلى دخولنا لمرحلة جديدة من تاريخ شبكة الإنترنت، والتي سيتم فيها استدعاء الناس ليقوموا بتوجيه مركبة التكنولوجيا بدلاً من أن يتم الأمر على خلاف ذلك. قد ننظر خلفنا إلى عام 2014 باعتباره العام الذي بدأت فيه شبكة الإنترنت بالنمو بشكل حقيقي.

نشر "العدوى العاطفية"

لقد أثارت دراسة الفيسبوك جدلاً واسعاً، وكأنها تقدم نشرة حول مستقبل أسود: وهي أدلة تجربية حول عدوى عاطفية واسعة الانتشار عبر شبكات التواصل الاجتماعي. ولكن لم تحظى الورقة بكثيرٍ من الملاحظة والتعليقات عندما نُشرِت لأول مرة في الثاني من حزيران/ يونيو من عام 2014 على موقع نشاطات الأكاديمية الأمريكية الوطنية (PNAS)، حيث غرقت بسرعة ضمن رزم المنشورات الأكاديمية. ولكن تغير ذلك بشكل مفاجئ بعد ثلاثة أسابيع في 26 حزيران/ يونيو، عندما نشرت الصحفية في مواضيع التكنولوجيا أفيفا روتكين ملخَّصاً عن الدراسة على موقع مجلة نيو ساينتيست New Scientist، حيث أشارت إلى أن الدراسة قد أجراها موظفٌ في موقع فيسبوك، وهو عالم نفس اجتماعي يدعى آدم كرامر، والذي يعمل في وحدة علوم البيانات الكبيرة ضمن الشركة، حيث ضمت أكثر من نصف مليون عضو في هذا الموقع. وبعد انتشار هذه الفضيحة، اندفع صحفيون آخرون إلى موقع PNAS ليلقوا نظرة على الورقة، وقد اكتشفوا بأن موقع الفيسبوك لم يعمل على إعلام مستخدميه بمشاركتهم في التجربة، ولم يحصل على موافقتهم بطبيعة الحال.

وقد تبع ذلك موجة من الغضب، وذلك عندما انتشرت القصة في أرجاء الوسائل الإعلامية. حيث أعلن موقع الأخبار التكنولوجية باندو ديلي PandoDaily "إذا ما زلت غير متأكد من حجم الازدراء الذي يكنه موقع الفيسبوك لمستخدميه، فإن هذا الخبر سيجعل كل شيء واضحاً كالشمس". واتهم أحد الكتاب في صحيفة ذا نيو يورك تايمز The New York Times موقع الفيسبوك بأنه يتعامل مع الناس كـ"فئران تجارب"، في حين انتقد فريق تحرير ذا واشنطن بوست The Washington Post الدراسة "لتعديها للحدود الأخلاقية". بينما طلب السيناتور الأمريكي مارك ورنر من هيئة التجارة الفدرالية عمل تحقيق في القضية، كما فتحت حكومتان أوروبيتان على الأقل تحقيقات حول ذلك. وكان تردود الفعل من شبكات التواصل الاجتماعي غاضبةً جداً. حيث غرَّد إرين كيسان، وهو محرر في أحد مواقع البرمجيات، "إرحل يا فيسبوك، وإذا كنت تعمل هناك، فانسحب بسرعة، إنهم سيئون جداً"، وكتب الناشط في قضايا الخصوصية لورين وينشتاين مستغرباً على موقع جوجل بلاس "لقد قتل الفيسبوك أي شخص من خلال حيلة التلاعب بالعواطف".

يمكن تسويغ جميع المخاوف الأخلاقية. فبالرغم من كون الفيسبوك، كشركة خاصة، غير مقيد بتوجيهات الموافقات المسبقة الخاصة بالجامعات والوكالات الحكومة، فإن قراره بعمل أبحاث نفسية على الناس من دون إخبارهم يُعد أمراً يستحق اللوم، فهي تخرق سياسة "وزارة الصحة والخدمات البشرية الأمريكية" لحماية دراسة الإنسان (تعرف بـ "القاعدة المشتركة") بالإضافة لخرقها للقانون الأخلاقي لجمعية علم النفس الأمريكية. وما جعل المخالفة أمراً لا يغتفر هو فشل الشركة في استبعاد القصَّر عن مجموعة التجربة. وذلك بالإضافة إلى أن عملية التلاعب بالمعلومات قد تمت من خلال باحثين إلكترونيين وليس من قِبَل الباحثين أنفسهم، وهي تفصيلة قدمها الفيسبوك خلال رافعته. وبحسب ما يشير أستاذ القانون في جامعة ميريلاند جيمس غريميلمان، فإن التلاعب النفسي يبقى تلاعباً نفسياً "حتى لو تم تنفيذه بطريقة آلية".

ومع ذلك تبدو كثافة ردود الفعل على ذلك غير متكافئة في أهدافها. فإذا ما تجاوزت الانتهاكات الأخلاقية والعنوان الرنان، قسيتبيَّن لك أن الدراسة مجرَّد عمل هزيل جداً. فقد كشفت الدراسات النفسية في السابق أن بعض الحالات المزاجية، كالعطاس، يمكن أن تكون معدية، أو أنك ستشعر بالحزن إذا ما رافقت أشخاصاً مصابين بالحزن، وإذا ما اجتمعت بأصحاب سعداء فسيصبح مزاجك أحسن حالاً. أراد كرامر وزملاؤه (شارك في الدراسة باحثين من جامعة كورنل) أن يبحثوا فيما إذا كان يمكن لهذه العدوى العاطفية أن تنتشر عبر شبكات التواصل الاجتماعي. فخلال أسبوع من شهر كانون الثاني/ يناير 2012، قاموا ببرمجة خوارزمية آخر الأخبار News Feed الخاصة بموقع الفيسبوك – وهي برمجية تختار ما يتم عرضه أو حذفه من صفحة المستخدم الرئيسية – بحيث يتم عمل تعديلات بسيطة على "المحتوى العاطفي" للأخبار التي يحصل عليها مجموعة عشوائية من المستخدمين. حيث تم إظهار أعداد إضافية من الرسائل "الإيجابية" لإحدى مجموعات الاختبار، بينما عُرِضت على المجموعة الأخرى أعدادٌ إضافية من الرسائل "السلبية". ولتصنيف الرسائل إلى إيجابية وسلبية، استخدم الباحثون برامج تحليل نصوص تدعى لينغويستيك إنكوايري Linguistic Inquiry (التحقيق اللغوي) وورد كوانت Word Count (عداد الكلمات)، حيث تقوم بتتبع الكلمات التي تُظهِر عواطف معينة في النصوص المكتوبة. ثم قاموا بتحليل مضمون منشورات المستخدمين بعد مشاهدتهم لتلك الرسائل ليشاهدوا ما إذا كان المضمون العاطفي للرسائل قد تأثر بتلك التعديلات على التي أجريت على صفحة أخر الأخبار.

وقد اكتشف الباحثون وجود تأثير لذلك. فالأشخاص الذين شاهدوا كلمات سلبية أكثر قاموا باستخدام كلمات سلبية أكثر في منشوراتهم وعلى نحو غير متوقع، في حين قام الأشخاص الذين شاهدوا كلمات إيجابية باستخدام كلمات إيجابية أكثر، ولكن التأثير كان باهتاً وصغيراً ولا يمكن قياسه إلا بنسب ضئيلة جداً، إلى درجة أنه لو كانت النتائج أكثر تشتتاً لكان من الصعب كشفها. وكما وضَّح كرامر في وقت لاحق في منشور نادم له على حسابه في الفيسبوك، فإن "التأثير الفعلي على الناس في هذه التجربة قد كان في أدنى المستويات حتى نتمكن من إحصاءها، وقد كانت النتيجة هي أن الناس ينتجون ما معدله كلمة عاطفية واحدة لكل ألف كلمة عرضت عليهم عبر الأسبوع بأكمله". وبحسب فكرة العدوى، فإن هذه نتيجة واهنةٌ جداً، حيث يبدو أنه من غير المرجح تأثُّر أي مشارك في الدراسة ولو بأقل تقدير، وبحسب ما أكَّد عليه كرامر، فإن "الفوائد التي خرجت منها هذه الدراسة قد لا تبرر كل هذا القلق".

معلومات ضخمة، أُناس ضئيلون

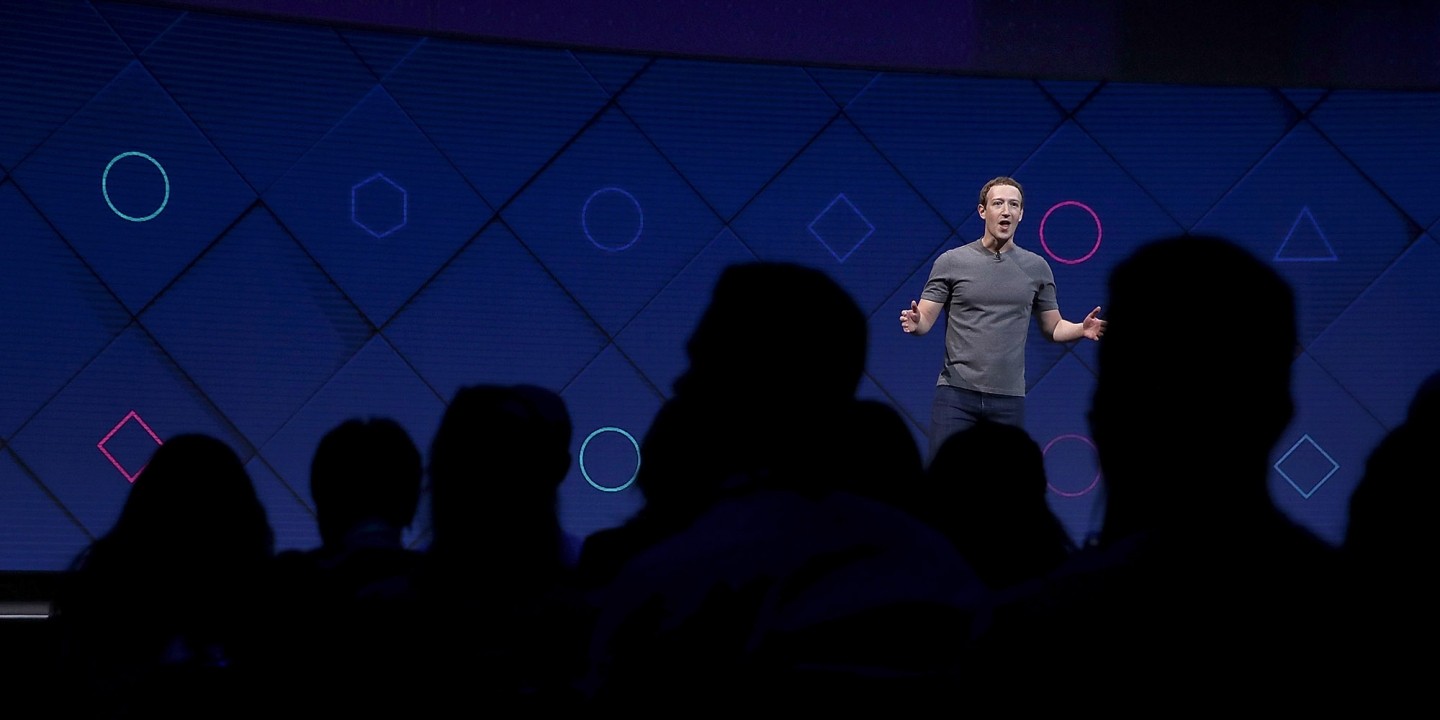

إن أكثر ما يثير القلق في هذه الدراسة ليس في تصميمها أو نتائجها، بل في اعتياديتها، فكما بيَّنت الردود الرسمية من موقع الفيسبوك حول حالة الجدل، فقد كانت تجربة كرامر هي الطرف الناتئ المرئي من الجبل الجليدي الضخم المغطى تحت الماء. ففي بريد إلكتروني للصحافة، قال متحدث باسم إحدى الشركات بأن الدراسة المنشورة في PNAS كانت جزءاً من سلسلة من الدراسات التي يجريها الفيسبوك ليفهم "كيف يستجيب الناس للمنشورات المختلفة، سواءً أكانت ذات مضمون إيجابي أم سلبي، أو أكانت أخباراً من الأصدقاء أم معلومات من الصفحات التي يتابعونها". كما دعَّمت مسؤولة عمليات الشركة شيرل ساندبيرغ هذه الرسالة خلال مؤتمر صحفي، حيث قالت: "لقد كانت هذه جزءاً من سلسلة من الأبحاث التي تجريها الشركات لاختبار المنتجات المختلفة، ولكن لقد حصل ما حصل". وتضيف قائلةً بأن المشكلة الوحيدة في هذه الدراسة هي أنها كانت "سيئة التواصل". كما أعلم العضو السابق في وحدة علوم البيانات في موقع فيسبوك أندرو ليدفينا مجلة ذا وول ستريت أن مختبر الشركة يعمل ضمن قيودٍ محدودة، حيث قال بأنه "بإمكان أي شخص في الفريق أن يجري أي اختبار، فهم يريدون دائماً أن يتحكموا بسلوك الناس".

لطالما حاول رجال الأعمال أن يتحكموا في سلوك الناس حيثما كانت هناك مشاريع لذلك، كما تُعدُّ أقسام التسويق ووكالات الإعلان ذات خبرة في صياغة واختبار ونشر الصور والعبارات التي تحفِّز الاستجابات العاطفية وتشكِّل السلوكات وتزيد الشراءات. ولطالما انهالت علينا الرسائل التي تريد التأثير على مشاعرنا ومنذ عقود طويلة، ابتداءً من صورة الطفل الملصقة على مسحوق غسيل آيفوري سنو وحتى صورة الرجل في إعلانات ماربلورو ومروراً بعيون الحبيبين المضاءة بالنجوم في عقارات سياليس. وتعد دراسة الفيسبوك جزءاً من هذا التقليد المهيب، ويتأكد ذلك مع الشبان الشجعان الذين تقدموا للدفاع عن هذه التجربة، فقد حاجج دونكان واتس، وهو باحث يدرس السلوكات القائمة في الإنترنت في شركة مايكروسوفت، قائلاً: "يتم التلاعب بنا في كل الأوقات ومن دون علمنا أو أخذ موافقتنا – من خلال المعلنين والمسوِّقين والسياسيين – ونحن نقبل بذلك باعتباره جزءاً من الحياة. كما قال نيكولاس كريستاكيس، وهو باحث في علم الاجتماع من جامعة يل استخدم بيانات من الفيسبوك من أجل إجراء دراسة له: "إن التسويق بشكل عام مصمم بحيث يتم التلاعب بالعواطف".

إن القول بأن "كل الناس يفعلون ذلك" لا يعد تبريراً مقنعاً، وهو خدَّاع في هذه الحالة تحديداً. فبفضل اتساع رقعة شبكة الإنترنت، فإن نوع الاختبارات النفسية والسلوكية التي يجريها الفيسبوك تختلف كماً ونوعاً عن الدراسات التسويقية السابقة. فلم تكن الشركات في السابق قادرة على جمع مثل هذه المعلومات الشخصية الحميمية حول أفكار وحياة الناس، كما لم يكن بمقدورهم أن يحددوا المعلومات التي يراها الناس بهذا الاتساع والدقة. فإذا ما قام مكتب البريد ذات مرة بالكشف بأنه كان يطَّلع على رسائل كل الناس ويختار أي الرسائل التي يجب إرسالها وأيها لا، فقد كان سيغضب الناس من ذلك، وهذا هو ما يقوم به الفيسبوك. فعند صياغة الخوارزميات التي تعمل في صفحة آخر الأخبار والخدمات الإعلامية الأخرى، فإنها تقوم بقولبة ما يراه أكثر من مليار عضو فيها ليقوموا بعد ذلك بتتبع ردود أفعالهم. ثم تستخدم البيانات المستخلصة من ذلك ليتم غجراء المزيد من التعديلات على الخوارزمية، لتعود دورة التجارب من جديد. وبحكم سرية هذه الخوارزميات، لا يمتلك الناس أي فكرة عن المدخل الذي ستلعب فيه هذه الخوارزمايت أو متى ولماذا.

لا يعد موقع الفيسبوك فريداً من نوعه في هذه الناحية. حيث تقوم معظم شركات الإنترنت بعقد تجارب مكثفة على مستخدميهم، محاولين أن يكتشفوا كيفية مضاعفة الوقت الذي يقضونه على البرنامج أو الموقع، أو كيفية زيادة فرص النقر على إعلان أو رابط ما، وذلك بالإضافة لأشياء أخرى أيضاً. ومعظم هذه الدراسات غير ضار، فقد جرَّب موقع جوجل مرة 41 درجة مختلفة من اللون الأزرق على شريط أدوات لأحد الصفحات من أجل أن يحدد أي الألوان سيولِّد المزيد من النقرات. ولكن بعض الدراسات ضارة أيضاً، فلست مضطراً لأن تكون شخصاً مذعوراً كي تستنتج بأن التجربة المنشورة في PNAS قد كانت إحدى أكثر تجارب التلاعب التي أجريت خلف الكواليس في شركات الإنترنت، ستردك ذلك إذا كنت شخصاً عاقلاً فقط.

لقد أصبح ذلك واضحاً جداً وسط الجدال على موقع الفيسبوك، وذلك عندما أعلن موقع إلكتروني مشهور آخر، وهو موقع أوكيوبيد OKCupid للتعارف، بأنه يقوم باستمرار بإجراء دراسات نفسية بحيث يتم علاج المعلومات لتساعد المستخدم الباحث عن الحب، حيث أجرى على سبيل المثال تجارب تتحكم بصورة الحساب الشخصية ومواصفاتها، بل قام بتمرير "معدلات تلاؤم" خاطئة ليعرفوا ما سيحدث إذا ما اعتقد الغرباء غير المتلائمين بأنهما مناسبين لبعضمها البعض. لم يكن موقع أوكيوبيد نادماً جداً على إساءة الثقة لعملاءه، حيث دوَّن أحد الشركاء المؤسسين للشركة كريستيان رودر "إحزروا ما الذي حصل جميعاً، إذا ما استخدمتم الإنترنت، فستكونون موضوعاتٍ لمئات التجارب في أي وقت ممكن وفي كل المواقع، فهكذا تعمل المواقع الإلكترونية".

تكمن مشكلة التلاعب في أنها تحصرنا في دائرتها، فهي تضعِفُ إرادتنا وتحد من قدرتنا على الاختيار، وتجعل نوايا الآخرين متحكِّمةً بنا. وعندما يتم إخفاء عملية التلاعب عنا، تزداد احتمالية وقوعنا كضحية لها. وبعيداً عن الأشخاص البليدين أو الساذجين، فقد كان معظم الناس في الماضي مدركين بأن التكتيكات التسويقية التي تمارسها الشركات تتعمد أن تكون ذات طبيعة تلاعبية، من الإعلانات وحتى دعايات المشاهير ومروراً بتصاميم الحقائب. ولكن طالما كانت هذه التكتيكات واضحة للعيان، فسيكون بمقدورنا تقييمها ومقاومتها، بل أن نسخر منها أيضاً. ولكن هذا يختلف عن حالتنا اليوم، على الأقل فيما يخص خدمات الإنترنت. فعندما تمارس الشركات سيطرة مستمرة على مجرى التفاعلات الشخصية والمعلومات الحميمية والحساسة الأخرى، وتعدل من طرق إخفاءها عنا، فلن يكون في مقدورنا إدارك ممارسات التلاعب هذه، ناهيك عن تقييمها، وسنجد أنفسنا عالقين في صندوق أسود.

ينسجم هذا مع مصالح موقع الفيسبوك وأوكيوبيد نحو العالم، أما ما يتعلق درجة انسجام ذلك مع مصالح الناس فهذه مسألة مختلفة. فما يهم هو "كيف تعمل المواقع الإلكترونية"، لا كيف ينبغي عليها أن تعمل.

حقُّك في أن تُنسى

تخيل نفسك في موقف ماريو كوستيجا جونزاليز. ففي عام 1998، مرَّ هذا الإسباني بأزمة مالية صغيرة، حيث تعثر في دين، وقد أجبر من أجل تسديده على أن يعرض بعض عقاراته للمزاد. وتم عرضها في صحيفة لا فانغارديا البرشلونية. تمت تصفية القضية، وأكمل كوستيجا جونزاليز حياته كعالم في الخطوط، وانمسحت الدين والمزاد والتقارير الصحفية من ذاكرة الناس.

ولكن بعد سنوات ، وبحلول عام 2009، عادت القصة للتداول. فقد وضعت صحيفة لا فانغارديا أرشيفها على الإنترنت، والتقطت خوارزمية جوجل المقالة القديمة عن المزاد، وتم إضافة المقال بشكل أوتوماتيكي إلى قاعدة بيانات محرك البحث، وبدأ رابط المقال بالظهور كلما قام شخصٌ في إسبانيا بعمل بحث حول اسم كوستيجا. أصيب كوستيجا بالفزع، فقد بدا الأمر ظالماً أن تتشوه سمعته بتقرير قديم حول مشكلة شخصية قديمة تم حلها منذ مدة طويلة. ومع ظهور المقال في نتائج البحث من دون أي توضيح، ظهر الرجل كشخص غارق في الديون. وشعر حينها، كما روى بعد ذلك، بوقوف كرامته على الحافة.

أرسل كوستيجا شكوى رسمية إلى وكالة حماية المعلومات التابعة للحكومة الإسبانية، وطلب من المنظمين أن يطالبوا الصحيفة بحذف المقال من الموقع وأن يطالبوا جوجل بوقف عرض الرابط في نتائج البحث. رفضت الوكالة أن تنفذ الطلب المتعلق بالصحيفة، مشيرين إلى شرعية نشر المقالة الأصلية، ولكنها وافقت على طلب كوستيجا المتعلق بجوجل، حيث طلبت من الشركة سحب قصة المزاد من النتائج. ناقشت جوجل القرار، قائلةً بأن عرض القصة يتعلق بوجودها في مكان آخر خارج جوجل. وانتقل النزاع إلى محكمة العدالة التابعة للاتحاد الأوروبي في لوكسمبورغ، حيث عرفت القضية باسم "حقك في أن تُنسى". وفي 13 أيار/ مايو من عام 2014، أصدرت المحكمة العليا قرارها، ووقفت مع كوستيجا ووكالة حماية المعلومات الإسبانية، حيث أصدر القضاة قراراً يُلزِمُ جوجل بالالتزام بالأوامر وسحب مقالة الصحيفة من نتائج البحث. ونتيجة كل ذلك هي: لقد حصل المواطنون الأوربيون فجأةً على حقهم بإلغاء أي معلومة غير ملائمة من محركات البحث.

اندهش الكثير من الأمريكان والقليل من الأوروبيين من هذا القرار. فقد شعروا بأنه قرارٌ غير عملي (فكيف يمكن لمحرك بحث عالمي يتعامل يومياً مع أكثر من 6 مليار بحث أن يقوم بالتدقيق في الاحتجاجات الشخصية للأفراد؟)، وذلك بالإضافة لما يشكله من تهديد لحرية سير المعلومات عبر الإنترنت. فقد اتهم العديد المحكمة بترخيصها لأنظمة رقابة أو حتى عمل "ذكريات مثقوبة" في التاريخ.

ولكن ردود الفعل الشديدة قد حادت عن الموضوع، بالرغم من كونها مفهومة، فقد أظهورا سوء فهمٍ لهذا القرار. فلم تعمل المحكمة على صياغة "حق في النسيان"، فقد ذُكِر هذا التعبير المجازي بشكل موجز في نص القرار، ولكن أدى اتصالها بالقضية إلى عمل تشتيت مؤسف. ففي مجتمع مفتوح، حيث تعتبر حرية التفكير والخطاب كمبادئ مقدسة، لا يمكن الدفاع عن الحق في النسيان باعتباره يتنافى مع حقك في أن تُذكر. فما كانت تدور حوله القضية هو حق الفرد في أن لا يتم تشويه سمعته بشكل منهجي. ولكن قد يعتبر وضع القرار ضمن هذه التعبيرات المبسَّطة أمراً مضللاً، فهي تستبطن بأن قرار المحكمة كان أوسع مما هو عليه.

إن القضية الجوهرية التي دعا لتشخصيها القضاة هي كيف لسياسة الاتحاد الأوروبي التي وضعت منذ عام 1995 في ما يتعلق بالمعلومات الشخصية، والتي تدعى بتوجيهات حماية المعلومات، كيف يمكن أن تنطبق على شركات، مثل جوجل، والتي تتعامل مع مجموعة واسعة من المعلومات عبر الإنترنت. فقد صدرت هذه التوجيهات لتسهيل عملية تبادل المعلومات عبر الحدود. تنص الوثيقة على أنه "حيثما كانت أنظمة معالجة المعلومات مصممة لخدمة الإنسان، فينبغي عليها أن تحترم حقوق الفرد وحرياته الشخصية، وأن تحترم حقه في الخصوصية تحديداً، والمساهمة في التقدم الاقتصادي والاجتماعي والتوسع التجاري والصحة النفسية للأفراد، بغض النظر عن جنسية أو مكان إقامة الشخص". ومن أجل حماية الناس من الظلم وإساءة التعامل، تفرض التوجيهات قوانين صارمة على المشاريع التجارية والمؤسسات الأخرى التي تعمل "كمتحكمين" في عمليات معالجات المعلومات الشخصية. فهي تتطلب – من بين الأشياء الأخرى – أن لا تكون المعلومات المنشورة من هؤلاء "المتحكمين" دقيقة وحديثة فحسب، بل عادلة ووثيقة الصلة و"غير مفرطة فيما يتعلق بأهداف جمعهم ومعالجتهم للمعلومات". ولكن الشيء غير الواضح التي تركته التوجيهات هو ما إذا كانت تلك الشركات الجامعة للمعلومات التي ينتجها الآخرون تقع ضمن فئة المتحكمين. وهذا ما قررته المحكمة.

لطالما قدَّمت محركات البحث وشبكات التواصل الاجتماعي والمواقع الأخرى نفسها كشبكات تلعب دوراً محايداً وإيجابياً فيما يتعلق بمعالجة المعلومات. باعتبار أنهم لا يصوغون المحتوى الذي ينشرونه، فالمحتوى يصوغه الناشرون في حالة محركات البحث، أو المستخدمون في حالة شبكات التواصل الاجتماعي. وبدلاً من ذلك، فهم يقومون ببساطة بجمع المعلومات وترتيبها بطريقة مفيدة. وهذا المنظور الذي تروج له جوجل بلا كلل – وتستخدمها الشركة كوسيلة للدفاع كما هي حالة كوستيجا – قد احتفى به الكثير من الناس أيضاً. وقد أصبح هذا هو المنظور الطبيعي للموضوع. عندما قال مؤسس ويكيبيديا جيمي ويلز خلال نقده لقرار المحكمة الأوروبية بأن "جوجل تساعدنا فقط على إيجاد الأشياء الموجودة في الإنترنت، فهو لم يكن يردد أقوال الشركة فقط، بل كان يعبر عن التصور الشعبي السائد حول جامعي المعلومات.

ولكن تبنت المحكمة منظوراً مختلفاً، فجمع المعلومات عبر الإنترنت لا يعد عملاً محايداً، فهي مخططة ولكن تحويلية أيضاً. فمن خلال جمع وتنظيم وترتيب المعلومات، تقوم محركات البحث بصنع شيءٍ جديد: وهو منتج مميز ومؤثر يعكس نوايا وأحكام فريق المحررين الخاص بالشركة، والتي تتجلى في خوارزميات معالجة المعلومات. حيث كتب القضاة بأن "عملية معالجة المعلومات الشخصية التي تتم في سياق عمل محرِّك البحث يمكن أن تختلف عن تلك التي يضعها الناشرون في الموقع الالكتروني بل يمكن أن تكون مضافةً عليها".

نظراً لقدرة محركات البحث على التأثير بشكل محدد . . . فإن الحقوق الأساسية المتعلقة بالخصوصية وحماية المعلومات الشخصية، وطبيعة عمل محرك البحث مع تحديد الشخص لأهدافه، ووسائل هذه العملية، كل ذلك ينبغي أن يتم ضمان – داخل إطار المسؤوليات والسلطات والإمكانيات – التزامه بمتطلبات توجيهات حماية المعلومات، من أجل ضمان عدم وجود تأثير على المستخدم.

لم تُصدِر المحكمة حكماً بناء على الضمانات الموجودة في توجيهات حماية المعلومات، ولا في أي قانون أو سياسة قائمة أو مستقبلية تتعلق بمسألة معالجة المعلومات الشخصية. كما لم تخبر المجتمع كيف يمكن أن تؤكد أو تشرع عمليات جمع المعلومات الخاصة بجوجل أو فيسبوك. ولم تعلِّق أيضاً على ماهية عمليات الشركات أو صناعة القرار التي ينبغي تنفيذها في تحديد المعلومات الشخصية التي ينبغي استبعادها من نتائج البحث، ومن الصعب إقرارها بطبيعة الحال. فما فعلته المحكمة، بصفاء وحكمة، هو أنها قدمت لنا طريقة للتفكير بعقلانية حول خوارزمية التلاعب بالمعلومات الرقمية والمسؤوليات الاجتماعية التي تتضمنها. إن مصالح شركة عالمية قوية مثل جوجل – وهي شركة تقدم خدمات لا غنى عنها للكثير من الناس – لا تتقاطع بشكل آلي مع الفرد الأعزل. فعندما يتعلق الأمر بعمليات محركات البحث أو جامعي المعلومات الآخرين، فإن العدالة لا تكون أكثر أهمية من المنفعة.

لم يكن قرار المحكمة نهاية المشهد، بل هو البداية، فهو يضع المجتمع أمام تحدٍ. فمسار معالجة المعلومات الشخصية الهائلة تُبرِزُ أسئلةً اجتماعية وقانونية وأخلاقية مهمةٍ ومعقدة، والأمر يتعلق بك أنت بأن تواجه هذه الأسئلة وتخلص إلى النتائج.

خوارزمياتنا، ذواتنا

لقد مررنا بوقت صعب ونحن نفكر في الشركات مثل جوجل وفيسبوك لأنه لم يسبق أن تعاملنا مع مثل هذه الشركات. فهي أشياءٌ جديدةٌ على العالم، ولا تنسجم بسهولة مع البنى القانونية والثقافية السائدة، لأنها تتحرك باتجاهات غير متخيلة، وتتناقل ملايين المعلومات في كل ثانية، وقد كنا نميل للتفكير فيها كحواسيب ضخمة وغير شخصية ونزيهة، باعتبارها آلات معالجة معلومات تتواجد خارج مجال تحكم وتفكير الإنسان، ولكن يمثل هذا سوء فهم، وهو أمر خطير.

حيث تمكن الحواسيب الحديثة وشبكات الحاسوب من أن يصبح حكم الإنسان مجرد نشاط آلي، وأن يتفاعل ضمن رقعة واسعة ومتسارعة. ولكنه يبقى حكماً إنسانياً، فالبشر هم من يبرمجون الخوارزميات، وهي تعكس مصالح وتحيزات وعيوب مصممها. وكما أشار مؤسس جوجل نفسه قبل عدة سنوات، فإن جامعي المعلومات الذين يعملون من أجل تحقيق مكاسب تجارية سيفكرون لا محالة بعقلية الصفقات وينبغي أن يتم التعامل معهم بحذر. وهذا أمر صحيح بالنسبة لمحرك بحث يتوسط في استكشافاتنا الثقافية، وهو أمرٌ صحيح أيضاً بالنسبة لشبكة تواصل اجتماعي تتوسط في علاقاتنا وحواراتنا الشخصية.

ولأن الخوارزميات تفرض علينا مصالح وتحيزات الآخرين، فنحن لا نمتلك الحق في التعامل معها بحذر وحسب، بل ملزمون أيضاً في أن نضبط هذه الخوارزميات في السياق المناسب. فنحن نمتلك الحق وملزمون أن نفهم كيف يتم التلاعب بنا وبمعلوماتنا. وإذا ما تجاهلنا هذه المسؤولية، أو تهربنا منها بحكم ما تثيره من مشاكل صعبة، فهذا يعني أننا نمنح مجموعة صغيرة من الناس – وهم الأشخاص الذين يجرون تجارب الفيسبوك وأكيوبيد – القدرة على اللعب بنا كما يريدون.

اقرأ/ي أيضًا | إسرائيل تتذرع بـ"الإرهاب" لفرض رقابة على الإنترنت

نيكولاس كار هو مؤلف كتاب "الضحالة: ما الذي يفعله الإنترنت بأدمغتنا، والذي وصل إلى المرحلة النهائية في جائزة بوليتزر. كما صدر له كتاب آخر بعنوان "القفص الزجاجي: الأتمتة ونحن.

التعليقات