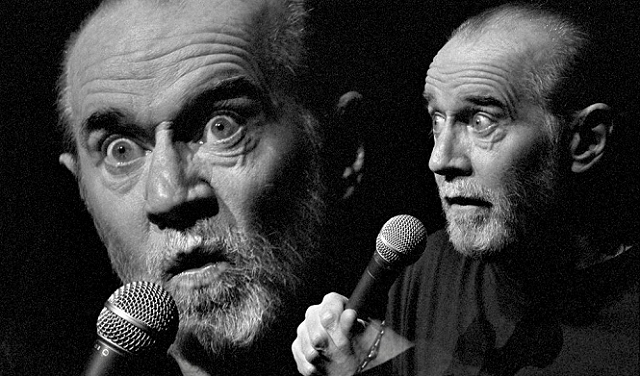

بعد جدل أثارته مدوّنة صوتيّة (بودكاست) أنتجت بالذكاء الاصطناعيّ تحاكي صوت الفكاهيّ الأميركيّ الشهير جورج كارلين الّذي توفّي عام 2008، عقد اتّفاق ودّيّ مع ورثة الكوميديّ الراحل أفضى إلى سحب الحلقة من المنصّات الّتي طرحت عليها.

وكان أفراد من عائلته قد تقدّموا بشكوى ضدّ القائمين على بودكاست "دوديزي" ("Dudesy") بعدما نشرا حلقة "استضافا" فيها الفكاهيّ الكوميديّ الراحل، مستخدمين الذكاء الاصطناعيّ لتقليد صوته وأسلوب نكاته.

وأثار البودكاست الجدل، خصوصًا بعد الإضراب الّذي شلّ هوليوود لأشهر طويلة العام الماضي وسلّط الضوء على إمكانات التهديد الّتي يشكّلها الذكاء الاصطناعيّ للصناعات الإبداعيّة.

وقالت ابنة الفكاهيّ كيلي كارلين "أنا سعيدة لأنّ هذا الأمر حلّ بسرعة وبشكل ودّيّ". وأبدت "الامتنان" لمقدّمي البودكاست "لتصرفهما بمسؤوليّة من خلال إزالة الفيديو الّذي صنعاه بسرعة".

ولم يكشف عن شروط الاتّفاق.

وأضافت كارلين "آمل أن تكون هذه القضيّة بمثابة تحذير بشأن المخاطر الّتي تشكّلها تقنيّات الذكاء الاصطناعيّ والحاجة إلى توفير الحماية المناسبة، ليس فقط للفنّانين وصنّاع المحتوى، ولكن لجميع البشر على هذا الكوكب".

ويستخدم الذكاء الاصطناعيّ بشكل متزايد في صناعة الترفيه لإنتاج المحتوى.

وتثير هذه التكنولوجيا الكثير من القلق، لأنّها تعتمد في بعض الأحيان على أعمال الفنّانين من دون موافقتهم وبلا مقابل لهم. كما أنّها تطرح مشاكل أخلاقيّة بسبب قدرتها على تقليد الموتى.

وشدّد محامي ورثة الفكاهيّ، جوش شيلر، على أنّ "هذه ليست مشكلة ستختفي من تلقاء نفسها"، مذكّرًا بأنّ الذكاء الاصطناعيّ أتاح تقليد صوت الرئيس جو بايدن في حملة ترويج انتخابيّ زائفة عبر الهاتف، أو توليد صور عارية مزيّفة لمشاهير.

وأضاف في بيان "يجب التصرّف بسرعة وقوّة في المحكمة، كما يجب على شركات برمجيّات الذكاء الاصطناعيّ الّتي تستخدم تقنيّاتها لأغراض مشكوك فيها أن تتحمّل بعض المسؤوليّة".

التعليقات